隨著生成式人工智能的興起,製作逼真的深度偽造視頻變得比以往任何時候都更容易和更快速。這些經過操控的視頻能夠迅速傳播錯誤信息,挑戰人們長久以來對視頻畫面作為可靠真相來源的假設。康奈爾大學計算機科學助理教授 Abe Davis 指出:「視頻曾經被視為真相的來源,但這已不再是我們可以輕易假設的事實。」他補充道:「現在幾乎可以創造出任何想要的視頻。這可能是有趣的,但同時也是有問題的,因為辨別真實與否變得越來越困難。」這一趨勢使得人們越來越難以分辨真實與虛假,讓事實查核者和公眾都感到嚴重擔憂。

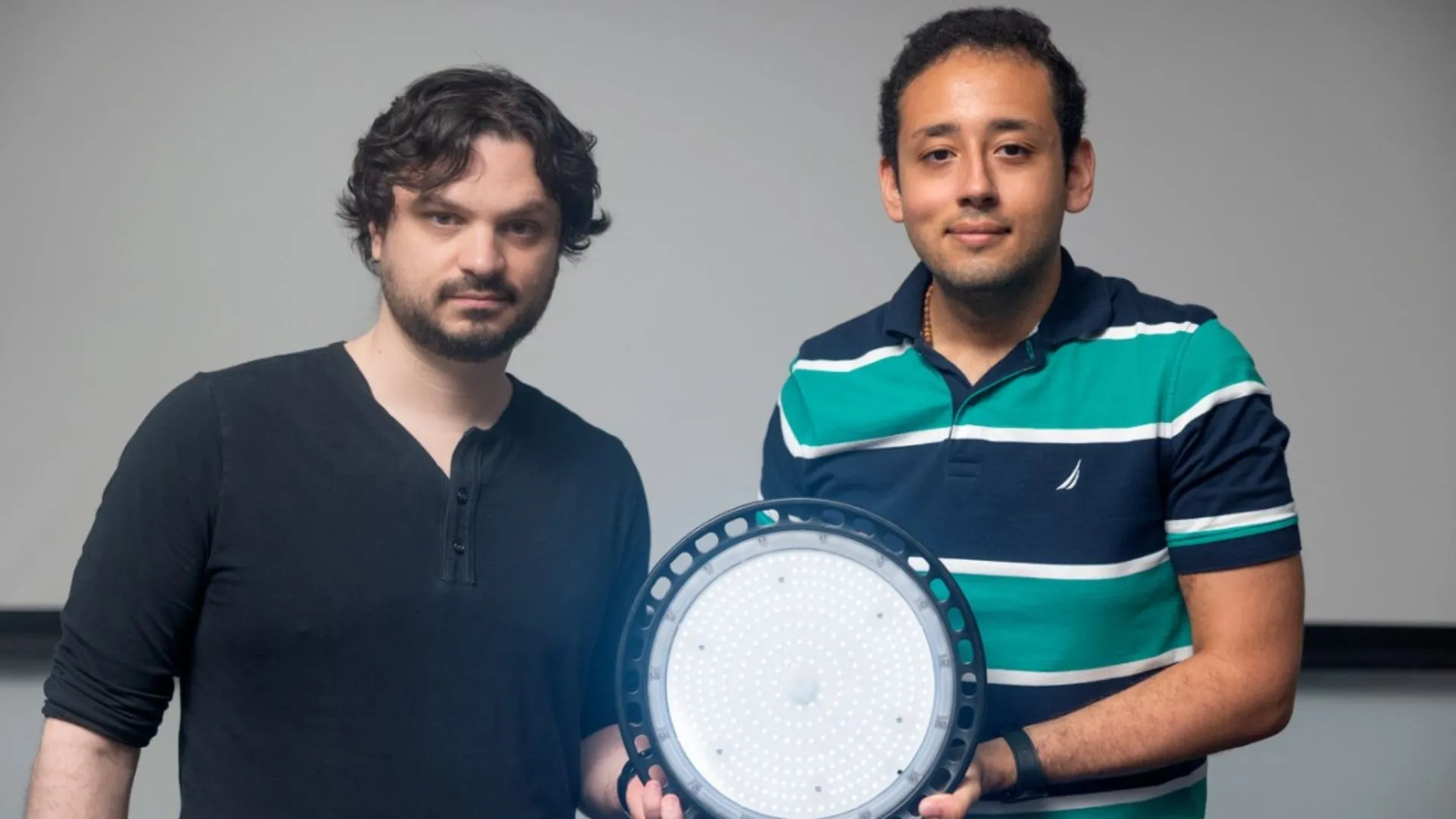

為了應對這一挑戰,康奈爾大學的研究團隊開發了一種方法,可以通過改變錄製時的光線來嵌入幾乎不可見的水印。與其數字水印視頻文件,這需要攝像頭或人工智能模型的配合,這種新方法通過環境光線的微妙變化來隱藏秘密代碼。這些光源,例如電腦屏幕、攝影燈,甚至是配備小型計算機晶片的普通房間燈,會在亮度上進行微妙的變化,這樣的變化幾乎是不可察覺的。這項研究的研究生 Peter Michael 解釋道:「我們利用人類感知文獻中的研究來指導我們的編碼光設計。這些代碼也被設計成看起來像是已經存在的隨機變化,稱為『噪音』,這也使得它們難以被察覺,除非你知道秘密代碼。」每個帶水印的光源都有一個獨特的代碼,可以用於稍後驗證視頻的真實性。

如果有人從例如一次訪談或政治演講中剪輯視頻片段,擁有代碼的法醫分析師可以識別出缺失的部分。如果對象被添加或替換,修改的部分在恢復的“代碼視頻”中通常會顯示為黑色,這些視頻是原始場景在稍微不同光線下的低保真、帶時間戳的版本。這些代碼視頻有助於檢測當操控的部分與深度偽造內容中的原始光線模式相矛盾時的情況。Davis 指出:「當某人操控一個視頻時,操控的部分開始與這些代碼視頻中的內容相矛盾,這讓我們能夠看到更改的位置。」此外,他還表示:「如果有人試圖用人工智能生成假視頻,生成的代碼視頻看起來只是隨機變化。」這個團隊成功地在同一場景中使用了多達三個不同光源的獨立代碼。「即使對手知道這項技術正在被使用並且以某種方式弄清楚代碼,他們的工作仍然會變得更加困難。」Davis 說。「他們不僅需要為一個視頻偽造光線,還需要為每個代碼視頻單獨偽造,所有這些偽造必須彼此一致。」

測試顯示,這一系統在某些戶外環境和不同膚色的人群中有效。然而,Davis 警告說:「這是一個持續存在的重要問題。它不會消失,事實上,這個問題只會變得更加棘手。」這項技術的發展不僅是對抗深度偽造視頻的一種新方法,還是對於確保數字媒體真實性的重要一步,顯示出科技在面對挑戰時的創新能力和不斷進步的潛力。