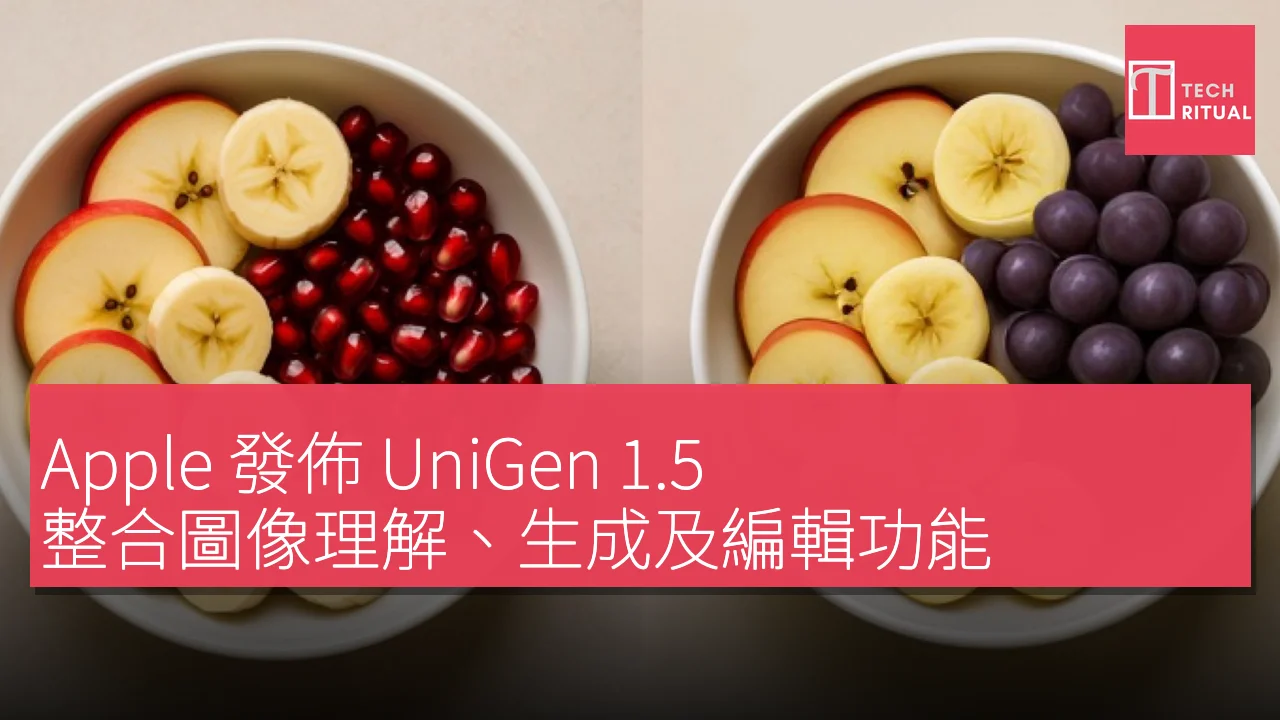

Apple 的研究團隊在之前的 UniGen 模型基礎上,展示了 UniGen 1.5,這是一個能夠在單一模型中處理圖像理解、生成和編輯的系統。以下是相關詳情。

UniGen 的前身於去年五月發表,名為《UniGen: Enhanced Training Test-Time Strategies for Unified Multimodal Understanding and Generation》。在這項研究中,他們介紹了一種統一的多模態大型語言模型,能夠在單一系統中進行圖像理解和生成,而無需為每個任務依賴不同的模型。如今,Apple 發佈了這項研究的後續成果,名為《UniGen-1.5: Enhancing Image Generation and Editing through Reward Unification in Reinforcement Learning》。

這項新研究通過為模型增添圖像編輯能力,擴展了 UniGen,仍然保持在單一統一框架內,而不是將理解、生成和編輯分成不同的系統。將這些能力統一在一個系統中是具有挑戰性的,因為理解和生成圖像需要不同的方法。然而,研究人員認為,統一模型可以利用其理解能力來提升生成表現。

根據他們的說法,圖像編輯中的主要挑戰之一是,模型往往難以完全理解複雜的編輯指令,特別是在變更細微或高度具體的情況下。為了解決這個問題,UniGen-1.5 引入了一個新的後訓練步驟,稱為編輯指令對齊(Edit Instruction Alignment)。研究人員指出:「此外,我們觀察到模型在經過監督微調後在處理多樣化編輯場景方面仍然不夠充分,因為其對編輯指令的理解不足。因此,我們提出編輯指令對齊作為輕量級的 Post-SFT 階段,以增強編輯指令與目標圖像語義之間的對齊。」

具體來說,該步驟將條件圖像和指令作為輸入,並針對通過文本描述預測目標圖像的語義內容進行優化。實驗結果表明,這一階段對提升編輯表現非常有幫助。

換句話說,在研究人員要求模型通過強化學習來改善其輸出之前,首先訓練模型根據原始圖像和編輯指令推斷編輯圖像應包含的詳細文本描述。這一步驟有助於模型更好地內化預期的編輯,然後再生成最終圖像。

接下來,研究人員以一種被認為是論文中最重要的貢獻的方式運用強化學習:他們為圖像生成和編輯使用相同的獎勵系統,這在以往是具有挑戰性的,因為編輯可以從細微調整到完全轉變。結果顯示,UniGen-1.5 在多個行業標準基準測試中,無論是在跟隨指令、保持視覺質量及處理複雜編輯方面,都匹配或超越了多種最先進的開放和專有多模態大型語言模型。

通過上述努力,UniGen-1.5 為統一的 MLLMs 研究提供了更強的基準,並在圖像理解、生成和編輯基準測試中建立了競爭性能。實驗結果顯示,UniGen-1.5 在 GenEval 和 DPG-Bench 上分別獲得 0.89 和 86.83,顯著超越近期方法如 BAGEL 和 BLIP3o。

在圖像編輯方面,UniGen-1.5 在 ImgEdit 上的整體得分為 4.31,超越近期開源模型如 OminiGen2,並與專有模型如 GPT-Image-1 相當。

以下是 UniGen-1.5 在文本生成及圖像編輯能力方面的一些示例(遺憾的是,研究人員似乎錯誤地裁剪了第一張圖像中的文本提示):研究人員指出,UniGen-1.5 在文本生成方面存在困難,並在某些情況下出現身份一致性問題。

UniGen-1.5 在文本生成和圖像編輯任務中的失敗案例如圖 A 所示。第一行展示了 UniGen-1.5 未能準確渲染文本字符的情況,因為輕量級的離散去標記器難以控制文本生成所需的精細結構細節。第二行顯示了兩個例子,其中圓圈標示了可見的身份變化,例如貓的面部毛發紋理和形狀的變化,以及鳥羽毛顏色的不同。為了解決這些限制,UniGen-1.5 仍需進一步改進。

完整研究報告可在此處查閱。

📬 免費訂閱 TechRitual 科技精選

每 3 日由 AI 精選 5 篇最重要香港科技新聞,直送你信箱