最近,一種新算法的研發旨在使機器人在與人類互動時作出更安全的決策。在工廠環境中,機器人與人類可以形成強大的團隊。機器人負責像組裝這樣的重複性任務,以快速和精確的方式完成,而人類則執行如質量控制等複雜工作。然而,人類天生易犯錯誤,且行為不可預測,這些突發行為可能會使即使是最先進的機器人也偏離預定的路徑,從而導致無法處理的情況。這些情況的後果往往是悲劇性的。例如,在2023年南韓的一起事件中,一台工業機器人致使一名工人在蔬菜包裝廠遭到致命壓傷。科羅拉多大學博爾德分校的研究團隊致力於縮小這一不確定性的鴻溝,提出了這一新算法,以幫助機器人在與人類互動時做出更安全、更智能的決策,即使在最大的不確定性中也能如此。

這種新算法的設計類似於人類的決策方式,機器人使用心理模型來預測人類的行為並作出反應。在一項新研究中,拉希賈尼教授及其研究生設計了算法,借鑒了「博弈論」的概念,這是一種分析戰略決策的理論。研究人員將博弈論應用於此問題,將機器人視為試圖「贏得」比賽的參與者。然而,因為人類的參與並不保證勝利,目標從贏得比賽轉變為尋找一種「可接受的策略」,讓機器人儘量完成其任務,同時最小化對人類的潛在傷害。拉希賈尼表示:「在選擇策略時,機器人不應該顯得過於對抗。為了給機器人增添柔和性,我們考慮到悔恨的概念。機器人未來是否會對其行動感到悔恨?在優化當前最佳行動時,應該選擇不會後悔的行動。」

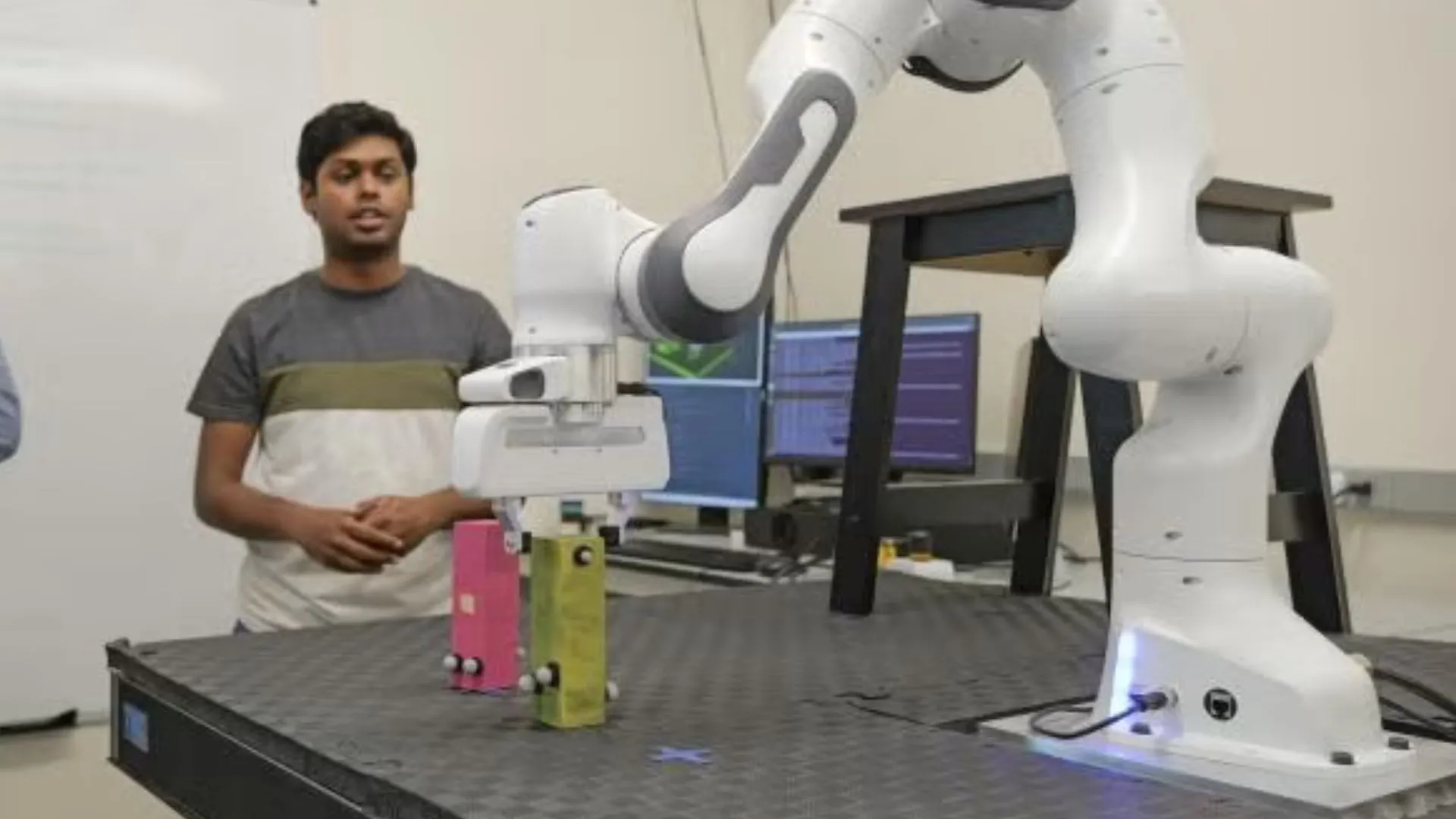

這個團隊設想了一種能夠智能回應的機器人,使用這些新算法。該系統的設計類似於棋手,旨在始終比人類高一個步驟,但其真正的優先考慮是人類的安全,而不是完美的預測。如果機器人的人類夥伴出現錯誤或行為不可預測,機器人第一步將是安全地糾正問題。如果這一措施失敗,機器人還可以採取主動措施,例如將工作移至更安全的地點,以完成任務而不危及人類。最終的目標非常明確:機器人必須適應人類,而不是反過來。拉希賈尼補充道:「你可能會遇到一個新手人類,或者一個專家人類,但對於機器人而言,無法預知將要面對的是哪一種人類,因此需要對所有可能的情況制定策略。」機器人在執行單調、重複的任務時展現出速度和穩定的精確度。作者認為,只要正確使用,機器人和人工智能可以增強人類的能力,機器人可以填補老年護理等領域的勞動力短缺,並承擔有損人類健康的體力勞動工作。這將使人類能夠專注於自身獨特的優勢,如智力、判斷和創造力。這些研究成果已於2025年8月在國際人工智能聯合會議上發佈。