韓國科技巨頭 LG 電子公司宣布,將於 2026 年 1 月 4 日在 CES 2026 展會上首次進行 LG CLOiD 的現場演示。LG CLOiD 是一款由人工智能驅動的家用機器人,代表了其零勞動家庭的願景。該機器人可以通過與連接的家電設備進行整合,處理日常任務。當 LG CLOiD 連接到 LG 的智能家居系統時,包括 ThinQ 平台和 ThinQ ON 中樞,將發揮更強大的功能。這種連接使 CLOiD 能夠順暢地控制和協調多種 LG 家電和服務。

在 CES 2026 展會上,LG 計劃展示這款人形機器人在不同場景中的運作。其中一個場景包括從冰箱中取出牛奶並將可頌放入烤箱中以準備早餐。另一個場景則涉及 LG CLOiD 啟動洗衣程序;機器人還會在衣物乾燥後摺疊和堆疊衣物。這些任務旨在展示人形機器人對人類生活方式的理解及精確的家電控制能力。

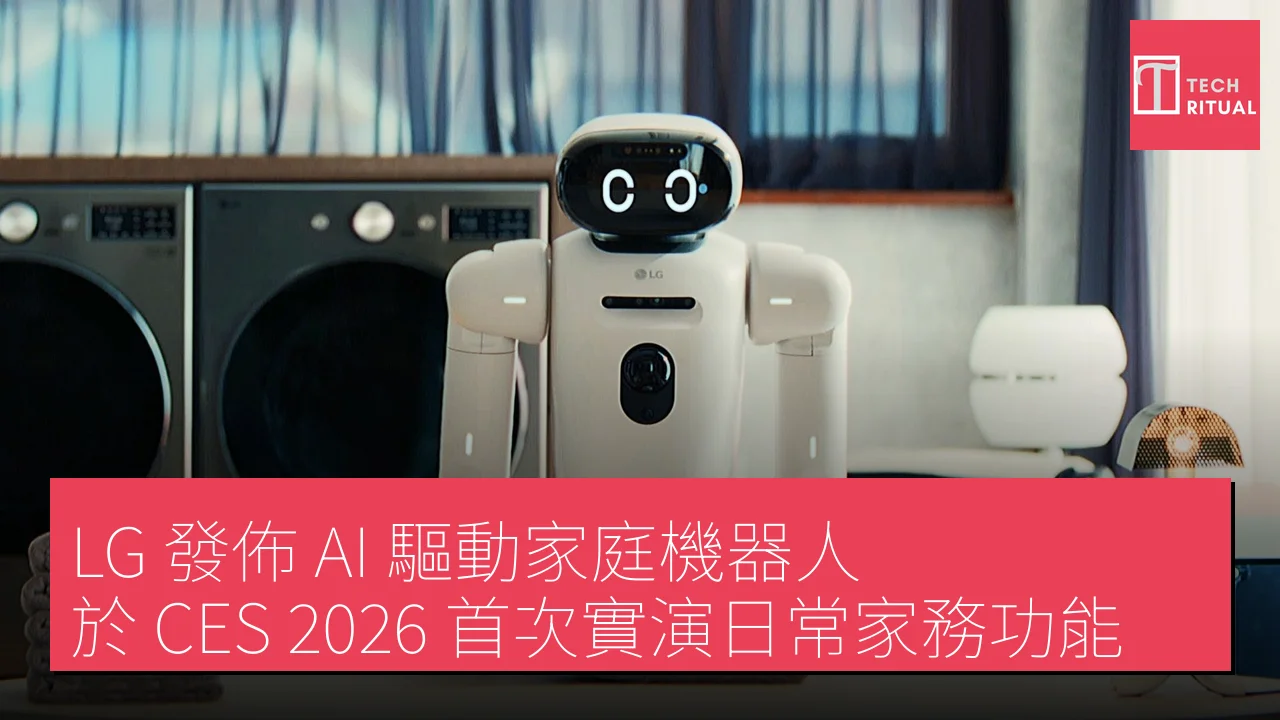

LG CLOiD 配備了軀幹、頭部和兩條可活動的手臂,並安裝在一個帶輪基座上以實現自主導航。其軀幹可以傾斜以調整高度,使機器人能夠從膝蓋高度及以上撿起物品。CLOiD 的每條手臂有七個自由度,類似於人類手臂,肩膀、肘部和手腕可以向前、向後、側向移動並旋轉,提供靈活的運動。每隻手也有五根獨立的手指,允許其小心地握持和處理物品。

得益於這種設計,CLOiD 能夠與多種家庭物品合作,在廚房、洗衣房和起居區等地方執行任務。機器人通過自駕技術在輪子上移動,這一技術基於 LG 的掃地機器人和 LG Q9。選擇這種設計是因為它穩定、安全,且建造成本更低。其低重心也有助於防止機器人翻倒,即使被小孩或寵物碰撞。

LG CLOiD 的頭部是 AI 移動中心,包含一個作為其大腦的芯片組。該機器人配備顯示屏、揚聲器、攝像頭、各種傳感器以及基於語音的生成 AI。這些元素共同協作,幫助人形機器人通過口語和面部表情與人類進行交流。

在核心技術方面,這款人形機器人配備了視覺語言模型(VLM),可將圖像和視頻轉換為結構化的語言理解。LG CLOiD 還配備了視覺語言行動(VLA)模型,將視覺和口頭輸入轉化為物理行動。這兩個模型經過數萬小時的家庭任務數據訓練,使 LG CLOiD 能夠識別家電、解釋用戶意圖並執行適當的行動,例如開門或執行物品的拾取和放置任務。

LG CLOiD 家用機器人的設計旨在自然地與服務對象互動並理解人類,提供優化的家庭幫助水平。LG 家電解決方案公司的總裁 Steve Baek 表示,訪客可在 CES 2026 的 LG 展位(#15004,位於拉斯維加斯會議中心)體驗 LG CLOiD 和零勞動家庭的優勢。