在 AI 大模型訓練及推理方面,NVIDIA 的顯卡無疑是目前使用最廣泛的選擇,與 AMD、Intel 及 Google 等公司的市場份額相比,顯得相形見絀。那麼,NVIDIA 究竟強在哪裡?這裡不談 CUDA 生態優勢,也不提 AI 算子等參數,Artificial Analysis 直接對比了當前三大推理方案的實際表現,使用了 Google TPU v6e、AMD MI300X 及 NVIDIA H100/B200 進行比較。

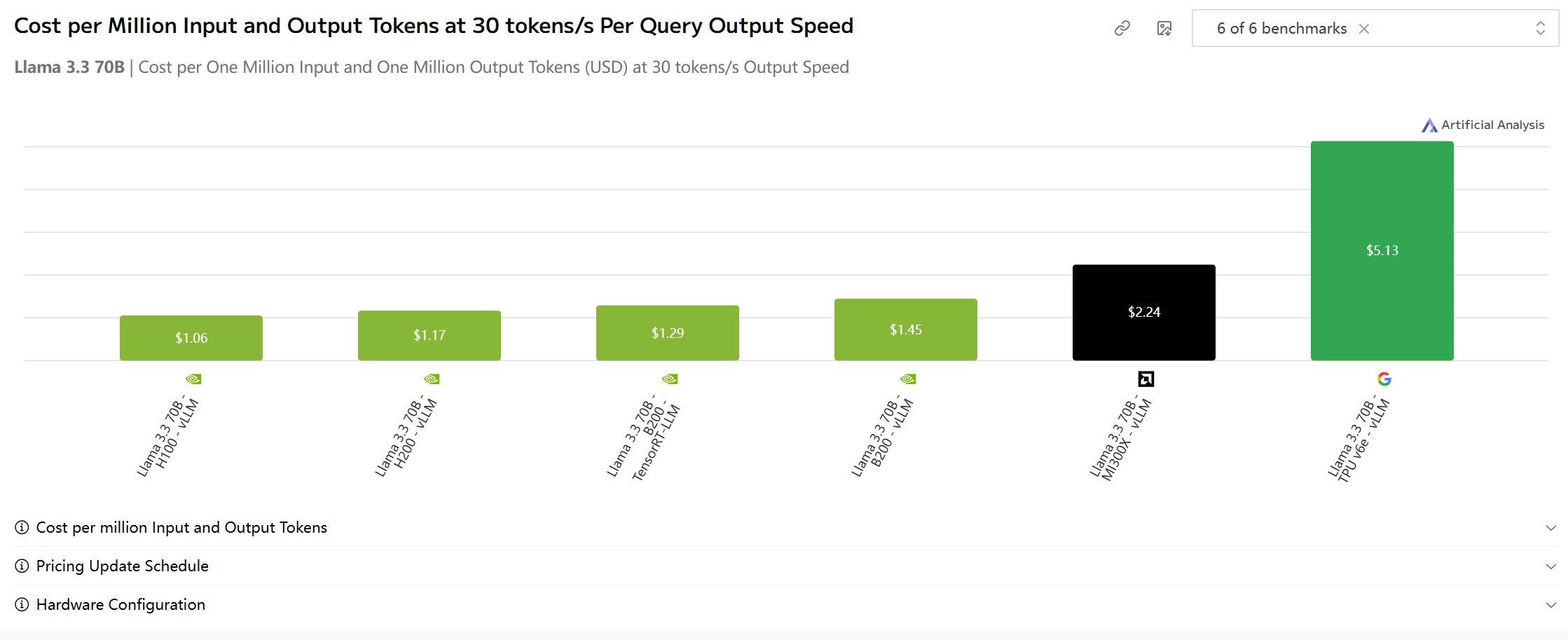

測試內容相當豐富,但我們只需關注一個綜合指標:在 30 Token/s 速度下,每百萬輸入輸出的成本,運行的模型為 Llama 3.

3 70B。在這方面,H100 的成本為 1.06 美元,H200 則為 1.17 美元,B200 TensorRT 為 1.23 美元,B200 為 1.45 美元,AMD 的 MI300X 為 2.24 美元,而 Google 的 TPU v6e 則高達 5.13 美元。

由此對比可見,NVIDIA 的顯卡相對於 AMD 至少擁有 2 倍的性價比優勢,相較於 Google 則約為 5 倍,差距十分明顯。即使是使用 NVIDIA 最新且價格最高的 B200 顯卡,成本的提升也不算太明顯,因為其性能大幅增強,仍然比 AMD 及 Google 的產品具備顯著優勢。

目前可以說,AMD 及 Google 的 AI 顯卡與 NVIDIA 還有不小的差距,但兩家廠商的下一代產品提升幅度頗大。AMD 的 MI400X 系列最多可達 432GB HBM4 顯存,而 Google 的 TPU v7 據說性能提升也會幾倍,屆時可能會改寫這一評測結果。當然,NVIDIA 也不會坐以待毙,下一代的 Rubin 顯卡已經發佈,預計明年將陸續上市,有望進一步擴大與競爭對手之間的差距。