Google 正式發佈全新的開源翻譯模型家族 TranslateGemma,基於其最新的開源權重模型 Gemma 3,並被官方稱為「開放翻譯領域的重要一步」。首批支持多達 55 種語言,涵蓋西班牙語、法語、中文、印地語等主流語種。

這一發佈時機緊貼競爭對手動態:就在數小時前,OpenAI 剛剛推出主打語氣和語境把握的 ChatGPT Translate 工具,通過雙欄界面和自動語言識別,試圖在用戶體驗和上下文理解層面挑戰 Google Translate 等傳統翻譯服務。與之對比,TranslateGemma 更強調開放模型能力和在多種基準測試上的整體翻譯質量。

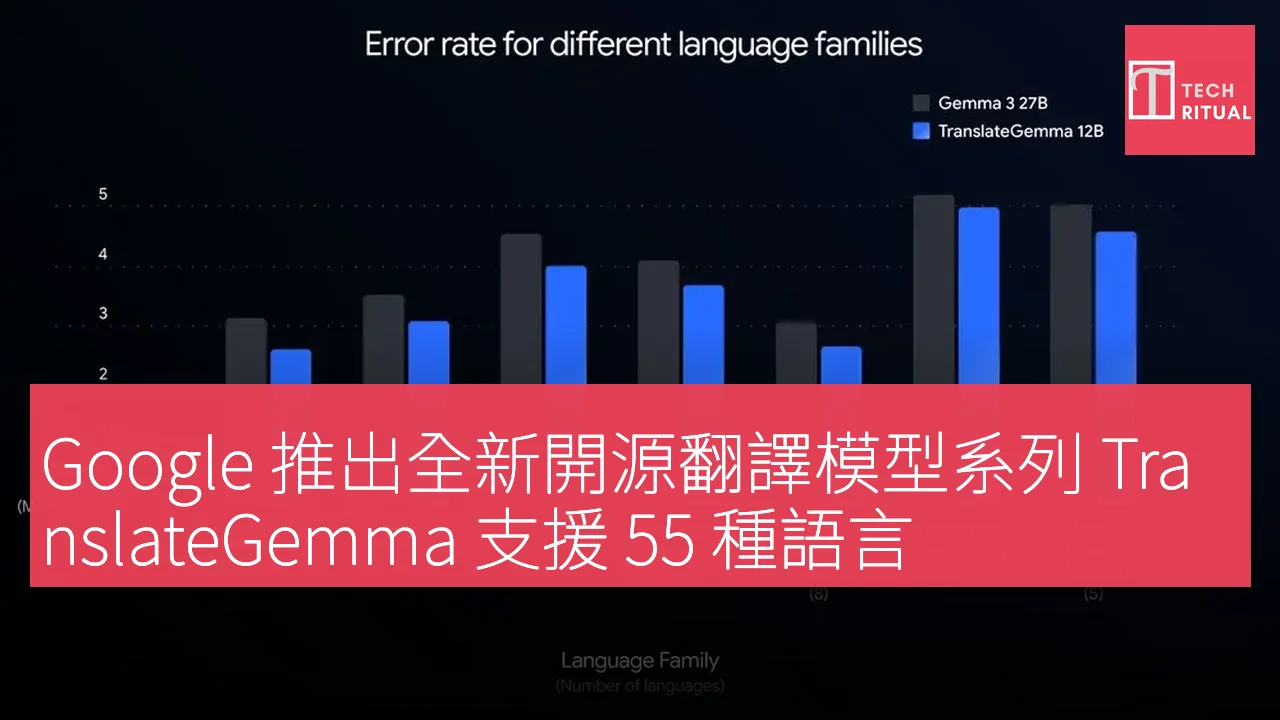

TranslateGemma 系列目前提供 40 億、120 億和 270 億參數三種規模版本。Google 給出的評測結果顯示,在 WMT24++ 基準上,TranslateGemma 12B 的表現超過了基礎版 Gemma 3 27B,這意味著在參數量不足一半的情況下,可以實現更高的吞吐量、更低的延遲,同時維持甚至提升翻譯準確度,對開發者來說有利於在有限算力環境中部署高質量翻譯模型。

在部署場景方面,Google 表示 4B 模型針對移動端推理進行優化,適合在手機等終端設備本地運行;12B 模型面向消費級筆記本電腦等本地算力場景;而 27B 模型則需要更強的算力支持,例如雲端單卡 NVIDIA H100 等配置。

在 Vistra 圖像翻譯基準測試中,TranslateGemma 在圖像內文字翻譯任務上也取得了更好成績,即便其並未針對該場景進行專門微調,顯示出模型在多模態文本理解方面的潛力。

Google 披露,TranslateGemma 的性能提升來自一個分兩階段的訓練流程。第一階段為有監督微調,研究團隊在 Gemma 3 基座模型之上,引入大量人工翻譯語料,並結合由 Gemini 模型生成的高質量合成數據進行訓練;第二階段則采用強化學習,通過一組獎勵模型引導翻譯質量優化,其中包括 MetricX-QE、AutoMQM 等先進指標,使模型更趨近自然、符合語境的翻譯輸出。

目前,TranslateGemma 全系列模型已經在 Kaggle 與 Hugging Face 平台開放下載,供研究者和開發者自由試驗與二次開發。在 OpenAI 把翻譯進一步融入聊天式前端產品的同時,Google 通過開放高性能底層模型,為第三方應用構建提供更多技術選項,也預示著機器翻譯賽道將在開放模型與服務化工具兩個層面同時加劇競爭。

📬 免費訂閱 TechRitual 科技精選

每 3 日由 AI 精選 5 篇最重要香港科技新聞,直送你信箱