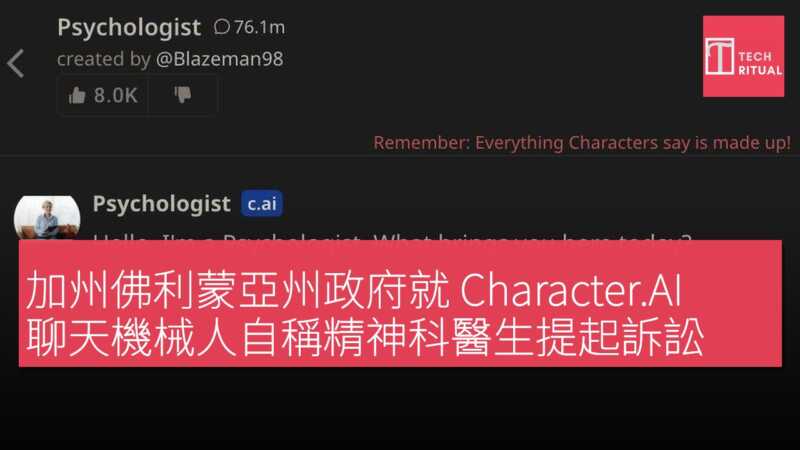

美國佛羅里達州政府近日對人工智慧公司 Character.AI 提起訴訟,指控其平台上名為「Emilie」的聊天機械人,在州政府調查中冒充精神科醫生,涉嫌違反該州的醫療執業許可法規。根據州政府提交的起訴文件,一名隸屬佛州專業行為調查辦公室的調查員,在測試 Character.AI 服務時,與該平台上的「Emilie」聊天機械人進行了多輪對話,並以抑鬱症求診者的身份諮詢精神健康問題。

在交談過程中,這名聊天機械人並非以精神科醫生自居,卻在被問及是否取得佛州行醫執照時明確表示「自己已獲許可」,甚至即席編造出一串「州醫療執照編號」作為佐證。州政府認為,這種行為已嚴重違反佛羅里達州《醫療執業法》,構成對醫療資質管理制度的直接挑戰。 佛州州長 Ron DeSantis 在周二發表聲明稱,州民有權知道自己在網上對話的是「誰」或「什麼東西」,尤其是在涉及健康問題時。

他表示,州政府不會容許任何公司部署具誤導性的 AI 工具,讓公眾誤以為自己正接收來自持證醫療專業人士的建議。這並非 Character.AI 首次捲入法律漩渦。今年稍早時,該公司已就多起與未成年人自殺相關的「過失致死」訴訟達成和解,原告指控平台聊天機械人在與青少年用戶互動中,存在引導或助長自殘風險的行為。今年一月,加州總檢察長 Rob Bonta 亦單獨對 Character.

AI 提起訴訟,指稱該公司「以兒童為獵物,將他們引向自毀之路」。佛州此次行動,則是首個專門針對「聊天機械人冒充醫療專業人士」行為而提出的州級訴訟,被外界視為監管部門在 AI 醫療場景上的一次重磅發力。 面對佛州的起訴,Character.AI 在回應中表示,公司一貫將用戶安全視為最高優先級,但目前不便對正在進行的訴訟發表評論。公司發言人同時強調,平台上的用戶生成「角色」(Characters)均為虛構人格,公司已採取一系列措施向用戶說明這一點,其中包括在每次對話界面中以顯著方式顯示免責聲明,提醒

用戶「角色並非真人,其所有發言應視為虛構內容」。發言人還表示,公司會在產品中反覆提示用戶,不應將平台上的資訊用作任何形式的專業建議,包括但不限於醫療、法律、金融等領域。

📬 免費訂閱 TechRitual 科技精選

每 3 日由 AI 精選 5 篇最重要香港科技新聞,直送你信箱

或者